ಟ್ವೀಟ್ಗಳು

- ಟ್ವೀಟ್ಗಳು, ಪ್ರಸ್ತುತ ಪುಟ.

- ಟ್ವೀಟ್ಗಳು & ಪ್ರತಿಕ್ರಿಯೆಗಳು

- ಮಾಧ್ಯಮ

ನೀವು @dennybritz ಅವರನ್ನು ತಡೆಹಿಡಿದಿರುವಿರಿ

ಈ ಟ್ವೀಟ್ಗಳನ್ನು ವೀಕ್ಷಿಸಲು ನೀವು ಖಚಿತವಾಗಿ ಬಯಸುವಿರಾ? ಟ್ವೀಟ್ ವೀಕ್ಷಣೆಯು @dennybritz ಅವರ ತಡೆತೆರವುಗೊಳಿಸುವುದಿಲ್ಲ

-

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

"Asymmetric opportunities: Invest in startups Start a company Create a book, podcast, video Create a (software) product Go on many first dates Go to a cocktail party Read a Lindy book Move to a big city Buy Bitcoin Tweet." -

@navalಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

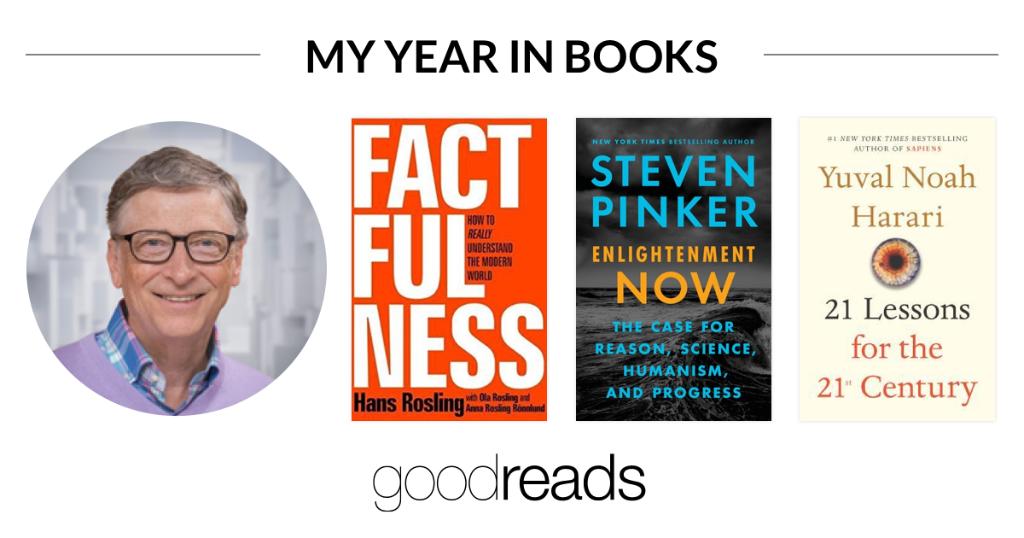

The books that kept me up reading in 2018: https://b-gat.es/2GBY13H pic.twitter.com/yaoBHNV4gR

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

My thesis "Acquiring Diverse Robot Skills via Maximum Entropy Deep Reinforcement Learning" has been accepted! Below is a 17 second summary. Thanks to my committee

@svlevine,@pabbeel, Mark Mueller and all the collaborators! https://www2.eecs.berkeley.edu/Pubs/TechRpts/2018/EECS-2018-176.html …pic.twitter.com/pVKb8QMM1Pಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

Not sure whether openreview is having the intended effect. Seeing lots of rejected paper tweets, essentially everyone is forced into the publication-by-tweet model even when the work is not ready. Also powerful rejected authors arguing, trying to have the last word

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

Machine Learning is being applied to everything lately and it SUCKS. I've seen a dozen *useful* tools come out lately that adopted ML over it's old security innards and it's glorified unicorn glitter, absolutely sparkling but totally ineffective. Stop using ML on solved problems.

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

I feel bad for eating something this cute-looking. Japanese students eat it before college entrance exams to have good luck.pic.twitter.com/CB8Y8TpWhc

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

I'm excited to be teaching courses on Deep Learning, Deep RL, and Human-Centered AI at MIT this January. Lectures will be recorded and are free and open to everyone athttps://deeplearning.mit.edu

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

“Technology come and go, but it has a lot in common. Set priorities right. Invest 80% of your learning time in fundamentals. Leave 20% for frameworks, libraries and tools.”” https://sizovs.net/2018/12/17/stop-learning-frameworks/ … The same applies to ML. Pick fundamentals over the latest Deep RL algo or xGAN.

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

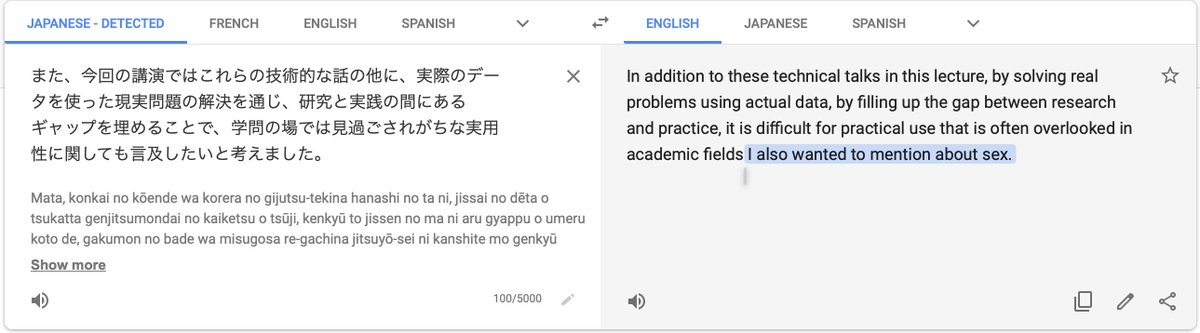

Wat? Go home google translate, you’re drunk… (the Japanese text does not mention sex lol)pic.twitter.com/A91Pu1ngKq

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

Since reading this 6 months ago, I've come to think it's half a dozen of the best paragraphs I've ever read on how to get much, much better at anything: (by

@autotrnslucence )pic.twitter.com/dMoEwHtjfU

ಈ ಥ್ರೆಡ್ ತೋರಿಸಿಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು

ಈ ಥ್ರೆಡ್ ತೋರಿಸಿಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Thanks everyone for the great suggestions, now I have a huge list of things to listen to. Twitter rockshttps://twitter.com/dennybritz/status/1074481721364475906 …

ಈ ಥ್ರೆಡ್ ತೋರಿಸಿಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

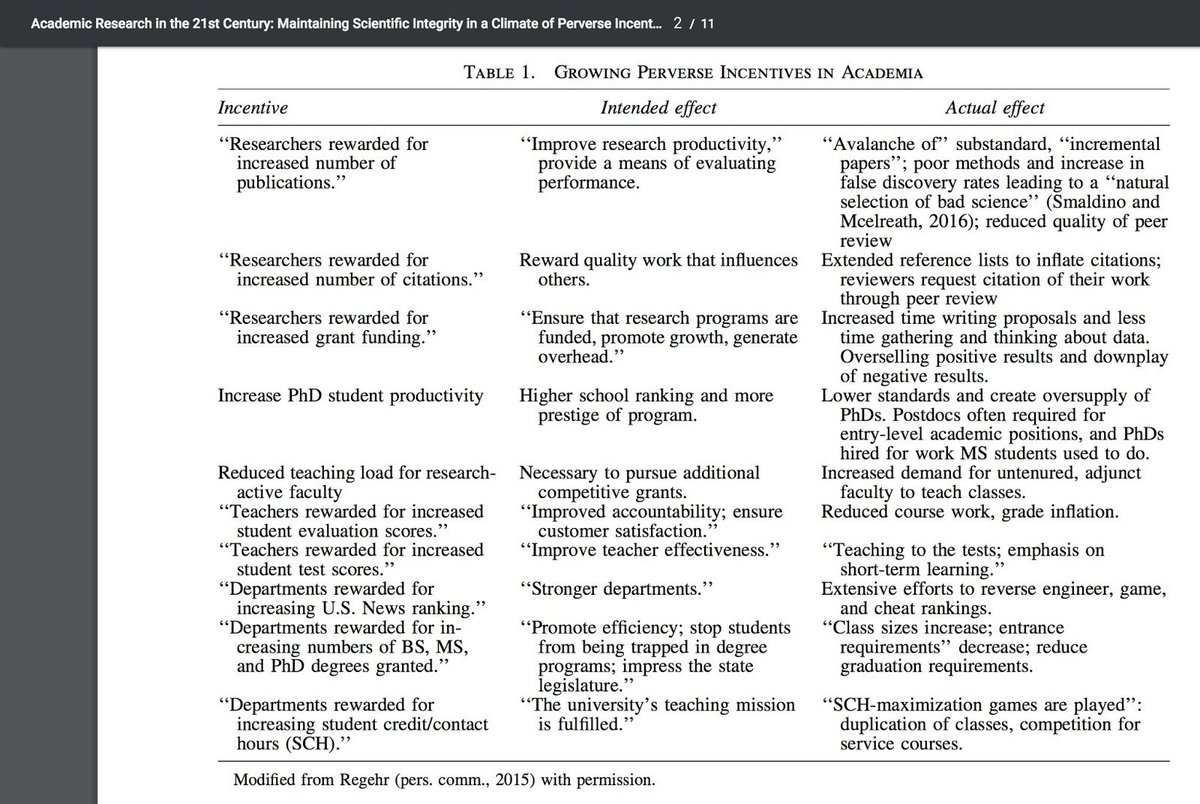

Academic incentives are hard. This article makes an interesting suggestion: An open-source software to collaboratively evolve metrics over time: http://backreaction.blogspot.com/2017/03/academia-is-fucked-up-so-why-isnt.html …pic.twitter.com/luRC8AUFD3

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

I’m trying to find something to do on my commute. Which audiobooks or podcasts are your favorites?

ಈ ಥ್ರೆಡ್ ತೋರಿಸಿಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

Hinton: "if you want to get a paper published in [ML] now it's got to have a table in it ... datasets ... methods ... and your method has to look like the best one. ... I don't think that's encouraging people to think about radically new ideas" -https://www.wired.com/story/googles-ai-guru-computers-think-more-like-brains/ …

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

How massively parallel can we train deep learning models? Readhttps://blog.openai.com/science-of-ai/

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

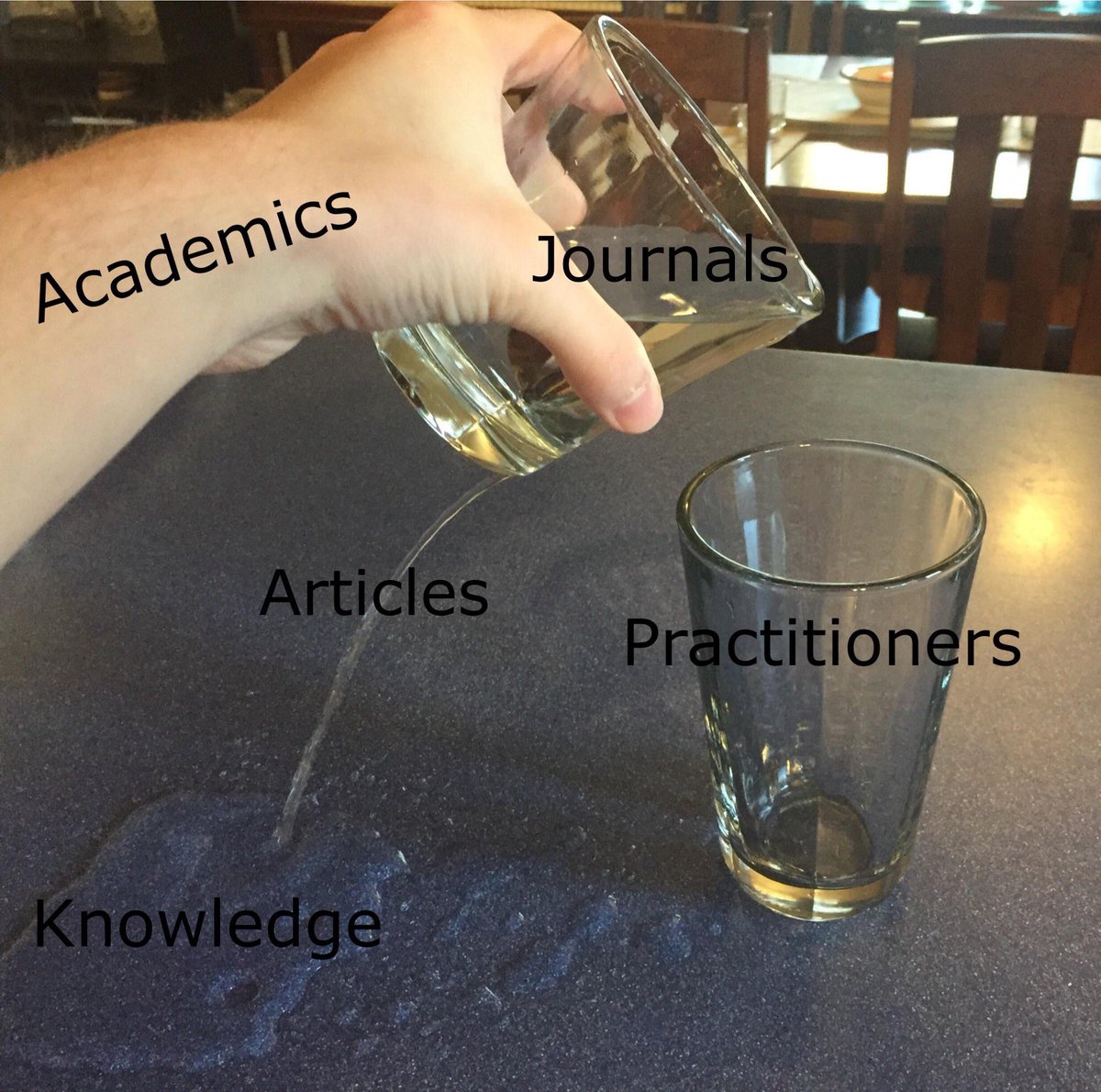

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

The academic publication process, courtesy of

@ebpmemespic.twitter.com/Xws8WJGZRm ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

In the next couple of years it will become so easy to synthetically generate realistic media (pictures, video, audio, etc) that it will become useless as way to transmit information. It will be useful only for entertainment purposes.

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

These results are really amazing (check out the video at https://www.youtube.com/watch?v=kSLJriaOumA …) I’m just a little bit sad that it’s not more difficult to generate our realistic and unique human faces :)https://twitter.com/mcleavey/status/1073275946164051968 …

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು

ಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

All scores substantially advance the state of the art, and are roughly the same (qualitatively) as our original scores (which use a different form of stochasticity during testing: a random # of no-ops vs. sticky actions). Go-Explore can thus handle test-time sticky actions. :-)

ಈ ಥ್ರೆಡ್ ತೋರಿಸಿಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು -

Denny Britz ಅವರು ಮರುಟ್ವೀಟಿಸಿದ್ದಾರೆ

2nd Update: Go-Explore when robustified with sticky actions on Montezuma’s Revenge scores an average of 281,264 (level 18) with domain knowledge (33,836 without). On Pitfall, the average score with domain knowledge is 20,527 with a max of 64,616 (!) All SOTA. Blog updated.pic.twitter.com/xVsAiWHmjs

ಈ ಥ್ರೆಡ್ ತೋರಿಸಿಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು

ಈ ಥ್ರೆಡ್ ತೋರಿಸಿಧನ್ಯವಾದಗಳು. Twitter ಇದನ್ನು ನಿಮ್ಮ ಕಾಲರೇಖೆಯನ್ನು ಉತ್ತಮಗೊಳಿಸಲು ಬಳಸುತ್ತದೆ. ರದ್ದುಗೊಳಿಸುರದ್ದುಗೊಳಿಸು

ಲೋಡಿಂಗ್ ಸಮಯ ಸ್ವಲ್ಪ ತೆಗೆದುಕೊಳ್ಳುತ್ತಿರುವಂತೆನಿಸುತ್ತದೆ.

Twitter ಸಾಮರ್ಥ್ಯ ಮೀರಿರಬಹುದು ಅಥವಾ ಕ್ಷಣಿಕವಾದ ತೊಂದರೆಯನ್ನು ಅನುಭವಿಸುತ್ತಿರಬಹುದು. ಮತ್ತೆ ಪ್ರಯತ್ನಿಸಿ ಅಥವಾ ಹೆಚ್ಚಿನ ಮಾಹಿತಿಗೆ Twitter ಸ್ಥಿತಿಗೆ ಭೇಟಿ ನೀಡಿ.